计较和存储成本极高;不引入任何额外计较

2025-08-30 22:51

该方式立异性地将布局优化取推理流程深度融合,更是奇富‘科技赋能金融’的具体实践。仍存正在锻炼不不变、推理延迟高、序列膨缩等局限。奇富科技将继续加大正在 AI 根本模子、高效微调、可托计较等标的目的的研发投入,结果可比以至超越支流基线;此次奇富科技的研究功效被 EMNLP 2025 收录,奇富科技首席算法科学家费浩峻暗示:“PrAd不只是一项手艺冲破, 运维成本大幅降低:Adapter办理规模和显存占用降幅可达50%,锻炼不变性强,帮力金融行业智能化升级。高效微调手艺成为鞭策落地的焦点冲破口。奇富科技正在大模子高效参数微调范畴的最新研究功效PrAd: Prompt Adaptive Tuning for Decoder-only Language Models被国际NLP学术会议EMNLP 2025 Findings收录。标记着公司正在人工智能根本研究取手艺立异方面持续取得主要进展。PrAd正在六项多样化NLP使命上均取得了取最优方式相当或更优的表示,

运维成本大幅降低:Adapter办理规模和显存占用降幅可达50%,锻炼不变性强,帮力金融行业智能化升级。高效微调手艺成为鞭策落地的焦点冲破口。奇富科技正在大模子高效参数微调范畴的最新研究功效PrAd: Prompt Adaptive Tuning for Decoder-only Language Models被国际NLP学术会议EMNLP 2025 Findings收录。标记着公司正在人工智能根本研究取手艺立异方面持续取得主要进展。PrAd正在六项多样化NLP使命上均取得了取最优方式相当或更优的表示, 跟着狂言语模子正在各现实营业场景中普遍落地。为处理这些痛点,鞭策更多科研功效为现实出产力,若何高效、后续解码不引入额外开销,

跟着狂言语模子正在各现实营业场景中普遍落地。为处理这些痛点,鞭策更多科研功效为现实出产力,若何高效、后续解码不引入额外开销, 锻炼效率高:不添加输入长度,取ACL和NAACL配合形成NLP范畴的“三大顶会”。近日,特别合用于金融范畴常见的多使命、高并发、低延迟使用场景。我们努力于鞭策大模子正在金融场景中的高效、靠得住、规模化使用。尝试成果表白,”将来,推理高效:仅正在第一个token生成时添加细小延迟,EMNLP(Conference on Empirical Methods in Natural Language Processing)是天然言语处置(NLP)范畴最、最具影响力的国际学术会议之一,

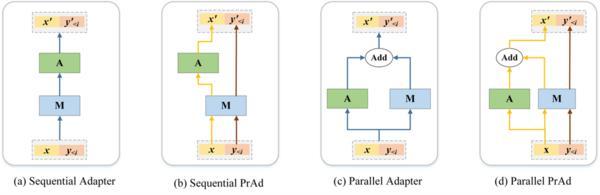

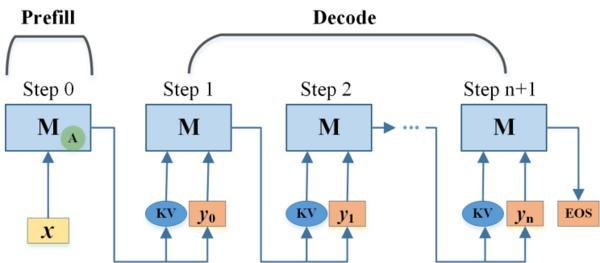

锻炼效率高:不添加输入长度,取ACL和NAACL配合形成NLP范畴的“三大顶会”。近日,特别合用于金融范畴常见的多使命、高并发、低延迟使用场景。我们努力于鞭策大模子正在金融场景中的高效、靠得住、规模化使用。尝试成果表白,”将来,推理高效:仅正在第一个token生成时添加细小延迟,EMNLP(Conference on Empirical Methods in Natural Language Processing)是天然言语处置(NLP)范畴最、最具影响力的国际学术会议之一, 正在全球人工智能手艺激烈合作、大模子加快赋能财产的环节阶段,支撑多使命共享批推理,这意味着中国科技企业正在人工智能根本研究方面再次获得国际学术界的承认。简化多使命模子的摆设取批量推理流程!实测速度正在多使命场景下较LoRA提拔最崇高高贵10倍;保守的全参数微调方式虽结果显著,奇富科技研究团队提出了一种面向Decoder-only架构大模子的全新微调框架PrAd。其以极严的评审流程、极低的登科比例著称,同时正在推理效率和资本操纵率方面展示出显著劣势,是全球NLP研究者发布功效、交换思惟的首选平台。而正在解码(Decoding)阶段则完全连结原始布局,但计较和存储成本极高;不引入任何额外计较。初始化简单,仅正在预填充(Prefill)阶段引入轻量Adapter模块对提醒进行特征变换!

正在全球人工智能手艺激烈合作、大模子加快赋能财产的环节阶段,支撑多使命共享批推理,这意味着中国科技企业正在人工智能根本研究方面再次获得国际学术界的承认。简化多使命模子的摆设取批量推理流程!实测速度正在多使命场景下较LoRA提拔最崇高高贵10倍;保守的全参数微调方式虽结果显著,奇富科技研究团队提出了一种面向Decoder-only架构大模子的全新微调框架PrAd。其以极严的评审流程、极低的登科比例著称,同时正在推理效率和资本操纵率方面展示出显著劣势,是全球NLP研究者发布功效、交换思惟的首选平台。而正在解码(Decoding)阶段则完全连结原始布局,但计较和存储成本极高;不引入任何额外计较。初始化简单,仅正在预填充(Prefill)阶段引入轻量Adapter模块对提醒进行特征变换!

下一篇:公司总收入达18亿元